이제 Qwen2, Qwen2_VL, Qwen2_5_VL 아키텍처의 사용자 정의 가중치를 가져올 수 있으며, Qwen 2, 2.5 Coder, Qwen 2.5 VL, QwQ 32B와 같은 모델을 포함합니다. 이 게시물에서는 Amazon Bedrock Custom Model Import를 사용하여 Qwen 2.5 모델을 배포하는 방법을 다루며, AWS 인프라 내에서 최신 AI 기능을 효율적인 비용으로 활용할 수 있습니다.

이제 Qwen2, Qwen2_VL, Qwen2_5_VL 아키텍처의 사용자 정의 가중치를 가져올 수 있으며, Qwen 2, 2.5 Coder, Qwen 2.5 VL, QwQ 32B와 같은 모델을 포함합니다. 이 게시물에서는 Amazon Bedrock Custom Model Import를 사용하여 Qwen 2.5 모델을 배포하는 방법을 다루며, AWS 인프라 내에서 최신 AI 기능을 효율적인 비용으로 활용할 수 있습니다.

이 포스트에서는 Amazon Bedrock의 기능을 활용하여 Amazon Web Services (AWS)에서 생성적 AI 애플리케이션을 구축하는 방법을 소개합니다. Amazon Bedrock를 사용하여 생성적 AI 여정의 각 단계에서 어떻게 활용할 수 있는지 강조하며, 숙련된 AI 엔지니어와 새로운 생성적 AI 분야의 입문자 모두에게 가치 있는 가이드입니다.

넷서티브가 아마존 베드락과 아마존 노바를 활용해 MLX에 생성적 AI 기반 어시스턴트를 도입하여 플랫폼의 차세대를 구현했다.

Amazon Nova, Amazon Rekognition 및 Amazon Polly와 같은 서비스를 사용하여 비디오 콘텐츠에 대한 접근성 있는 오디오 설명을 자동화하는 방법을 소개합니다. 이 접근 방식은 시각 장애를 가진 관객들을 위해 비디오를 접근 가능하게 만드는 데 필요한 시간과 비용을 크게 줄일 수 있습니다.

도쿄 과학 연구소가 아마존 세이지메이커 하이퍼팟을 사용하여 70억 개의 파라미터를 가진 일본어 능력이 향상된 대형 언어 모델 Llama 3.3 Swallow을 성공적으로 훈련시켰다. 이 모델은 GPT-4o-mini 및 다른 선두 모델을 능가하는 일본어 작업에서 우수한 성능을 보여준다. 이 기술 보고서는 프로젝트 중 개발된 훈련 인프라, 최적화 및 모범 사례를 상세히 설명한다.

Articul8가 일반적인 LLM을 능가하는 도메인 특화 모델로 기업용 생성적 AI를 재정의하고, Amazon SageMaker HyperPod가 이를 어떻게 가속화했는지 살펴봅니다. Articul8의 반도체 모델은 최고의 오픈 소스 모델 대비 2배 높은 정확도를 달성하며 배포 시간을 4배 단축했습니다.

비디오앰프는 AWS Generative AI Innovation Center (GenAIIC) 팀과 협력하여 비디오앰프 자연어(NL) 분석 챗봇 프로토타입을 개발하고 아마존 베드락을 활용해 미디어 분석 데이터에서 의미 있는 통찰력을 대규모로 발견하는 방법을 소개합니다.

Adobe는 AWS 창조적 AI 혁신 센터와 협력하여 아마존 베드락 지식 베이스와 벡터 엔진을 사용했고, 이를 통해 개발자 지원 시스템을 혁신하였으며 검색 정확도가 20% 향상되었다. 본문에서는 이 솔루션에 대한 세부 내용과 Adobe가 개발자 생산성을 향상하는 방법에 대해 논의한다.

Bito는 소프트웨어 개발자를 위한 AI 에이전트를 만드는 혁신적인 스타트업이다. 이 게시물에서는 아마존 노바를 사용하여 Bito가 AI 기반 코드 리뷰의 무료 티어 옵션을 제공하는 방법을 소개한다.

가르데니아 테크놀로지는 AWS PACE 팀과 협력하여 최신 생성 AI 모델을 활용한 완전 자동화 ESG 보고 솔루션 ‘Report GenAI’를 개발했다. 이 기술은 RAG와 텍스트-to-SQL 기능을 활용해 고객들이 ESG 보고 시간을 최대 75% 줄일 수 있도록 도와준다. AWS 서버리스 기술과 아마존 베드락의 에이전트를 결합하여 확장 가능하고 유연한 문서 어시스턴트 애플리케이션을 구축하는 방법을 소개한다.

NVIDIA의 최신 추론 모델인 Llama 3.3 Nemotron Super 49B V1 및 Llama 3.1 Nemotron Nano 8B V1이 Amazon Bedrock Marketplace 및 Amazon SageMaker JumpStart에서 사용 가능해졌습니다. AWS에서 NVIDIA의 새로운 추론 모델을 배포하여 생성적 AI 아이디어를 구축, 실험 및 확장할 수 있습니다.

아마존 베드록과 LangGraph를 활용하여 전자 상거래 소매업체를 위한 맞춤형 고객 지원 경험 구축하는 방법을 소개하고, Mistral Large 2 및 Pixtral Large 모델을 통합하여 티켓 분류, 주문 세부 정보 추출, 손상 평가, 문맥적 응답 생성 등 핵심 고객 지원 업무를 자동화하는 방법을 안내합니다.

Amazon Bedrock Guardrails를 사용하여 해로운 다중 모달 콘텐츠를 차단하는 방법을 소개하고, 의료 보험 콜 센터 시나리오를 활용하여 다양한 가드레일을 구성하고 테스트하는 과정을 안내합니다.

Amazon Bedrock의 채택이 증가함에 따라, 비용 최적화는 필수적이며 조직의 예산과 일치시키고 관리 가능한 생성적 AI 애플리케이션의 배포 및 운영 비용을 돕는다. 이 글에서는 Amazon Bedrock을 사용하면서 전략적 비용 최적화 기술에 대해 배울 수 있다.

E.ON은 아마존 텍스트랙트의 창의적인 응용과 커스텀 이미지 분석, 펄스 카운팅을 결합하여 실제 문제를 대규모로 해결하는 방법을 소개한다. 스마트 미터 오류를 짧은 스마트폰 비디오로 진단함으로써 E.ON은 비용을 절감하고 고객 만족도를 향상시키며 전체 에너지 서비스 신뢰성을 향상시키고자 한다.

Pipecat과 Amazon Bedrock을 활용해 지능적인 AI 음성 에이전트를 구축하는 방법을 배울 수 있는 시리즈 포스트. Amazon Bedrock의 foundation 모델을 활용하는 이 프레임워크는 음성 및 멀티모달 대화형 AI 에이전트를 위한 오픈소스이며, 구현을 안내하기 위한 고수준 참조 아키텍처, 모범 사례 및 코드 샘플이 포함되어 있다.

웹 오디오 API와 Amazon Transcribe 스트리밍을 이용한 실시간 이중 채널 전사를 가능하게 하는 웹 응용 프로그램의 구현 세부 사항을 탐색합니다. AudioContext, ChannelMergerNode 및 AudioWorklet의 조합을 사용하여 두 마이크로폰에서 오디오 데이터를 실시간으로 처리하고 인코딩 한 후 Amazon Transcribe로 전송합니다.

글로벌 풀서비스 디지털 마케팅 기관 Kepler는 아마존 Q Business를 도입하여 AI 접근을 민주화하고 엄격한 보안 기준을 유지함으로써 직원 당 주당 평균 2.7시간의 수동 작업 시간을 절약하고 고객 서비스 제공을 개선했다.

이 포스트에서는 Amazon Bedrock Marketplace에서 제공되는 Open AI Whisper foundation model Whisper Large V3 Turbo를 사용하여 거의 실시간 트랜스크립션을 생성하는 방법을 보여줍니다. 이 트랜스크립션은 Amazon Bedrock에 의해 처리되어 요약 및 민감한 정보의 마스킹이 이루어집니다.

이 블로그 포스트에서는 자연어 및 이미지 쿼리를 사용하여 시맨틱 비디오 검색을 위해 대형 비전 모델(LVMs)을 활용하는 방법을 소개합니다. 시간 프레임 부드럽게 하는 등의 사용 사례별 메소드를 소개하여 비디오 검색 성능을 향상시킵니다. 또한, Hugging Face Model Hub의 공개 LVMs를 활용하여 비디오, 이미지 및 텍스트 처리를 수행하기 위해 Amazon SageMaker AI에서 비동기 및 실시간 호스팅 옵션을 사용하여 이 접근 방식의 엔드 투 엔드 기능을 설명합니다. 마지막으로 Amazon OpenSearch Serverless를 사용하여 저지연 시맨틱 비디오 검색을 수행합니다.

본문에서는 다중 계정을 가진 기업이 공유 Amazon SageMaker HyperPod 클러스터에 액세스하여 다양한 작업을 실행하는 방법에 대해 논의합니다. SageMaker HyperPod 작업 규제를 사용하여 이 기능을 가능하게 합니다.

이 게시물에서는 생성 모델 AI를 사용하여 데이터를 쿼리하는 주요 옵션을 평가하고, 그 강점과 한계를 논의하며, Text-to-SQL이 결정론적이고 스키마별 작업에 가장 적합한 선택인 이유를 설명합니다. Amazon Nova를 사용하여 Text-to-SQL을 효과적으로 활용하는 방법을 보여줍니다.

Radial은 중소 및 대기업 브랜드에게 통합 결제, 사기 탐지 및 옴니채널 솔루션을 제공하는 최대 3PL 충족 공급 업체이다. 이 게시물에서는 Radial이 Amazon SageMaker를 사용하여 머신 러닝 워크플로우를 현대화함으로써 사기 탐지 머신 러닝 응용 프로그램의 비용과 성능을 최적화하는 방법을 소개한다.

맥락적 검색은 각 청크에 설명적 맥락을 추가하여 임베딩을 생성함으로써 전통적인 RAG를 향상시킨다. 이 접근 방식은 관련 맥락 정보로 벡터 표현을 보강하여 사용자 쿼리에 응답할 때 의미적으로 관련된 콘텐츠를 더 정확하게 검색할 수 있게 한다.

본문에서는 AWS Graviton 인스턴스와 호환되도록 미리 구축된 컨테이너를 확장하여 SageMaker AI에 소형 언어 모델을 배포하는 방법을 소개합니다. 솔루션의 개요와 구현 단계에 대한 자세한 설명을 제공하며, GitHub 저장소에서 예제 노트북을 찾을 수 있습니다.

Impel이 Amazon SageMaker에서 세바지 메이커를 사용하여 자동차 딜러쉽 고객 경험을 향상시키는 방법을 소개합니다.

기후 기술 스타트업들이 환경 데이터를 활용한 기본 모델(FMs)을 개발하여 탄소 포집, 탄소 부정적 연료, 미세 플라스틱 파괴를 위한 새로운 소재 디자인, 생태계 보존 등의 문제에 대처하고 있음. 이러한 특수 모델은 방대한 양의 데이터를 효과적으로 처리하고 분석하기 위해 고급 컴퓨팅 능력이 필요함.

Anthropic에서 출시된 코딩 에이전트인 Claude Code와 Amazon Bedrock 프롬프트 캐싱을 결합하여 개발 워크플로우를 개선하는 방법을 살펴볼 것이다. 이 강력한 조합은 추론 응답 대기 시간을 줄이고 입력 토큰 비용을 절감함으로써 빠른 응답을 제공하게 된다.

최근 생산적 AI 기업들이 자사의 제품을 개발하는 데 투자함에 따라 모델 능력에서 놀라운 발전이 있었습니다. Anthropic의 Claude Opus 4 & Sonnet 4와 Amazon Bedrock의 Amazon Nova와 같은 언어 모델은 점점 더 정교하게 추론, 작성 및 응답 생성이 가능해졌습니다. 그러나 이러한 모델이 강력해지더라도, 그들은 여전히 […]

Bevar Ukraine은 우크라이나 난민들을 위한 AI 어시스턴트 Victor를 개발했다. 이는 AWS 서비스를 활용하여 다국어 지원, 자동화된 지원 및 데이터 보안 및 GDPR 준수를 유지하면서 난민들의 요구를 해결하는데 중점을 둔다.

Noodoe가 AI와 Amazon Bedrock을 활용하여 전기차 충전 운영을 최적화하는 방법을 탐색합니다. LLM 통합을 통해 Noodoe는 역동적인 가격 책정과 다국어 지원을 가능하게 하며, 이러한 혁신은 다운타임을 줄이고 효율성을 극대화하며 지속가능성을 향상시킵니다.

이 글에서는 Amazon Bedrock 지식 베이스 내에서 GraphRAG를 활용하여 지식 기반 애플리케이션을 구축하는 방법을 탐구합니다. 기존의 벡터 검색과는 달리, 지식 그래프는 엔티티 간의 관계를 인코딩하여 대규모 언어 모델이 문맥을 고려한 추론을 통해 정보를 검색할 수 있습니다.

AWS CDK 및 AWS Step Functions, Amazon EventBridge, Amazon Personalize와 같은 서비스를 활용한 MLOps 솔루션을 소개하며, Amazon Personalize의 데이터 준비, 모델 학습, 배포 및 모니터링을 자동화하는 방법을 설명합니다.

FDA와 같은 규제기관이 규정을 변경하면 조직은 내부 SOP를 검토해야 합니다. 이를 위해 Amazon Bedrock를 활용하여 규정 변경과 SOP 간의 관계를 파악하는 다양한 방법을 소개합니다.

이 글에서는 Terraform을 사용하여 SageMaker 프로젝트의 사용자 정의 템플릿을 정의, 배포, 프로비저닝하는 방법을 소개합니다. 다른 IaC 도구에 의존하지 않고 Terraform Enterprise 인프라 내에서 엄격하게 SageMaker 프로젝트를 활성화할 수 있습니다.

ZURU가 AWS Generative AI Innovation Center와 AWS Professional Services와 협력하여 생성 모델 AI를 활용한 더 정확한 텍스트-바닥 도면 생성기를 구현했다. 이 글에서는 대형 언어 모델 (LLM)을 활용한 해결책이 선택된 이유와 모델 선택, 프롬프트 엔지니어링, 파인튜닝을 통해 결과를 개선하는 방법을 살펴본다.

실시간 사용자 피드백과 감독을 통해 이점을 얻는 대화형 응용 프로그램과 달리, 비대화형 응용 프로그램은 더 강력한 가드레일과 철저한 품질 보증이 필요하며 Amazon.com의 네 가지 생성 AI 응용 사례를 살펴봅니다.

글에서는 성숙한 생성형 AI 기반의 개요를 제시하고 구성 요소를 탐구하며 종단간의 전망을 제시합니다. 다양한 운영 모델을 살펴보고 해당 기반이 그 한계 내에서 운영될 수 있는 방법을 탐구합니다. 마지막으로 기업이 진화 경로를 평가하는 데 도움이 되는 성숙도 모델을 제시합니다.

OpenSearch는 다양한 제3자 머신러닝(ML) 커넥터를 제공하여 이를 지원합니다. 이 포스트에서는 Amazon Comprehend 커넥터와 Amazon Bedrock 커넥터 두 가지를 소개합니다. Amazon Comprehend 커넥터를 사용하여 LangDetect API를 호출해 문서의 언어를 감지하는 방법과 Amazon Bedrock 커넥터를 사용하여 Amazon Titan Text Embeddings v2 모델을 호출하여 문서로부터 임베딩을 생성하고 의미 검색을 수행하는 방법을 보여줍니다.

Amazon Bedrock의 Model Copy 및 Model Share 기능은 AI 애플리케이션의 라이프사이클을 개발부터 프로덕션까지 효과적으로 관리하는 강력한 옵션을 제공한다. 본문에서는 Model Share와 Model Copy 기능에 대해 심층적으로 살펴보고, 전형적인 개발부터 프로덕션 시나리오에서의 기능, 장점, 실용적인 적용을 탐구한다.

이 글에서는 선도적인 GeoFM인 Clay Foundation의 Clay foundation 모델이 Amazon SageMaker에서 대규모 추론과 세밀한 조정을 위해 어떻게 배포되는지 살펴본다.

LlamaIndex 프레임워크를 활용하여 에이전틱 RAG 애플리케이션을 구축하는 예시를 소개합니다. 이 애플리케이션은 Mistral Large 2 FM을 활용해 에이전트 플로우에 대한 응답을 생성하여 연구 도구로 활용됩니다.

이 글에서는 아마존 노바 캔버스 이미지 생성 모델에 초점을 맞추고, 이미지 생성 과정(확산)의 개요를 제공하며, 아마존 노바 캔버스를 활용한 텍스트-이미지 생성을 위한 입력 매개변수에 대해 깊이 파헤칩니다.

아마존 노바 캔버스가 고급 이미지 생성 기술을 통해 실제 비즈니스 문제를 해결하는 방법을 탐구합니다. 이 기술의 강력함과 유연성을 보여주는 인테리어 디자인 및 제품 사진 촬영 두 가지 구체적인 사용 사례에 초점을 맞춥니다.

Amazon Bedrock의 다중 에이전트 협업 능력을 활용하여 다중 에이전트 투자 연구 보조 도구를 구축하는 방법을 안내합니다. 특화된 AI 에이전트 팀이 함께 작업하여 금융 뉴스를 분석하고 주식 성과를 평가하며 포트폴리오 할당을 최적화하고 종합적인 투자 통찰을 제공하는 솔루션을 소개합니다.

이 블로그는 생성 모델 AI 및 아마존 베드락을 사용하여 유전체 데이터베이스에 자연어 질문을 하는 텍스트-SQL 파이프라인을 배포하는 것을 탐구합니다. AWS Amplify를 사용하여 AI 어시스턴트 웹 인터페이스를 구현하는 방법과 SQL 쿼리를 생성하는 데 채택된 프롬프트 엔지니어링 전략을 설명합니다. 마지막으로, 서비스를 자체 AWS 계정에 배포하는 방법을 안내합니다.

Gemma 3 27B 모델이 Amazon Bedrock Marketplace와 SageMaker JumpStart를 통해 이용 가능하다. 어떻게 시작하고 강력한 지시 지향 기능을 활용하는지 안내.

이 글에서는 Amazon Bedrock 데이터 자동화를 사용하여 멀티모달 콘텐츠를 처리하고 추출된 정보를 Amazon Bedrock 지식 베이스에 저장한 다음 RAG 기반 Q&A 인터페이스를 통해 자연어 질의를 가능하게 하는 풀 스택 애플리케이션을 구축하는 방법에 대해 안내합니다.

이 포스트에서는 비즈니스 요구에 맞게 Foundation 모델을 맞춤화하는 세 가지 강력한 기술인 RAG, 세밀 조정, 그리고 두 가지 방법을 결합한 하이브리드 접근 방법을 구현하고 평가하는 방법을 안내합니다. 이러한 접근 방법들을 실험하고 특정 사용 사례와 데이터셋을 기반으로 현명한 결정을 내리는 데 도움이 되도록 준비된 코드를 제공합니다.

AI 쇼핑 어시스턴트인 Rufus는 AWS AI 칩과 병렬 디코딩을 활용하여 프라임 데이의 수요를 충족시키며 응답 시간을 2배로 빠르게 하고 추론 비용을 50% 절감하며 피크 트래픽 중에도 원활한 확장성을 달성했습니다.

아마존 베드락 데이터 자동화는 조직이 개발을 간소화하고 효율성을 향상시키는데 도움이 됩니다. 비디오 또는 오디오에 대한 구조화되지 않은 콘텐츠 처리를 대규모로 간소화하며, 새로운 기능을 통해 비디오와 오디오에서 장면 요약, 주요 주제, 고객 의도 등을 더 빠르게 추출할 수 있게 해줍니다. 이는 영상과 오디오의 가치를 끌어내어 판매 생산성 향상 및 고객 경험 향상과 같은 사용 사례에 활용할 수 있습니다.

GuardianGamer는 Amazon Nova와 Amazon Bedrock을 활용하여 확장 가능하고 효율적인 감독 플랫폼을 제공합니다. 부모에게 의미 있는 인사이트를 제공하면서도 게임 활동과 소셜 상호작용을 감시하는 비침입적인 방법을 유지합니다.

프린시펄 파이낸셜 그룹이 Amazon QuickSight 대시보드를 활용해 통합 음성 가상 비서 보고 및 분석 솔루션을 구축하는 방법을 탐구합니다.

이 게시물은 Amazon Bedrock, 사용자 피드백 데이터셋 및 퓨-샷 프롬프팅을 결합하여 응답을 미세조정하여 사용자 만족도를 높일 수 있는 방법을 보여줍니다. Amazon Titan Text Embeddings v2를 사용하여 응답 품질을 통계적으로 유의미하게 향상시켰으며, 정확하고 개인화된 응답을 원하는 애플리케이션에 유용한 도구로 나타냈습니다.

아마존 Q 비즈니스는 마이크로소프트 365 애플리케이션과의 통합을 통해 팀이 일상적으로 사용하는 도구 내에서 강력한 AI 지원을 제공합니다. 본문에서는 Outlook과 Word를 위한 이러한 통합이 업무 흐름을 어떻게 변화시킬 수 있는지 살펴봅니다.

이 글에서는 Amazon Bedrock 에이전트를 Slack 워크스페이스에 통합하는 솔루션을 제시합니다. Slack 워크스페이스 구성, Amazon Web Services에 통합 구성 요소 배포, 이 솔루션 활용 방법에 대해 안내합니다.

아마존 베드락과 랭체인을 활용하여 안전한 분산 로깅을 위한 솔루션을 소개합니다.

이 블로그 포스트에서는 Amazon Bedrock를 활용하여 보험 데이터를 처리하는 다중 에이전트 협업 파이프라인을 소개하며, 분류, 변환 및 메타데이터 추출을 위한 전문 에이전트를 특징으로 합니다. 이 도메인에 대한 인식 접근 방식이 청구 문서, 비디오 및 오디오 파일과 같은 다양한 데이터 형식을 메타데이터로 변환하여 사기 탐지, 고객 360도 전망 및 고급 분석을 가능하게 하는 방법을 보여줍니다.

Onity Group은 Amazon Bedrock 및 기타 AWS 서비스를 활용하여 문서 처리 능력을 혁신하였습니다. 새로운 솔루션 덕분에 이전 OCR 및 AI/ML 솔루션 대비 20%의 정확도 향상과 50%의 문서 추출 비용 절감 효과를 거뒀습니다.

HERE 기술은 GenAIIC와 협력하여 사용자의 자연어 질의에 대한 설명과 실행 가능한 코드 솔루션을 제공하는 지능형 AI 코딩 어시스턴트를 만들었습니다. 사용자의 질문을 자연어로 HTML 코드로 번역하고 JavaScript를 삽입하여 즉시 상호작용 지도로 렌더링할 수 있는 확장 가능한 시스템을 구축하는 것이 요구되었습니다.

Amazon Q Business를 사용하여 백엔드 통합을 위한 사용자 정의 플러그인을 구축하는 방법을 소개합니다. 이 플러그인은 기존 시스템과 제3자 시스템을 몇 주 만에 개발없이 통합하고 중요한 워크플로를 자동화할 수 있습니다. 또한 Amazon Cognito 및 AWS IAM Identity Center를 사용하여 솔루션을 안전하게 유지하고 민감한 데이터 및 워크플로의 무결성을 유지하는 방법을 보여줍니다.

본 포스트는 RAG 기반 응용 프로그램을 위한 기본 환각 탐지 시스템을 만드는 방법을 안내하며, 정확도, 정밀도, 재현율 및 비용 측면에서 다른 방법의 장단점을 고려합니다.

스쿠데리아 페라리 HP가 머신러닝을 활용해 정확한 피트스톱 분석 기술을 개발하는 방법을 소개하는 글.

SageMaker AI와 SiMa.ai Palette 소프트웨어 스위트를 사용하여 모델을 재학습하고 양자화하는 방법을 소개하며, 시야 및 보호 장비 감지가 규정 및 안전을 위해 중요한 환경에서 개인을 정확하게 감지하는 것을 목표로 합니다.

Apoidea 그룹은 Amazon SageMaker HyperPod를 활용하여 대형 비전 언어 모델(LVLMs)을 사용하여 은행 및 금융 문서에서 테이블 구조 인식 성능을 더욱 향상시키는 방법을 탐구한다. Qwen2-VL-7B-Instruct 모델을 LLaMA-Factory를 사용하여 세밀하게 조정하는 방법을 소개한다.

Qualtrics가 Amazon SageMaker와 Amazon Bedrock을 활용해 구축한 AI 플랫폼인 소크라테스에 대해 소개합니다. Qualtrics는 이를 통해 고객 솔루션과 생성 모델 AI를 구현하고 있습니다.

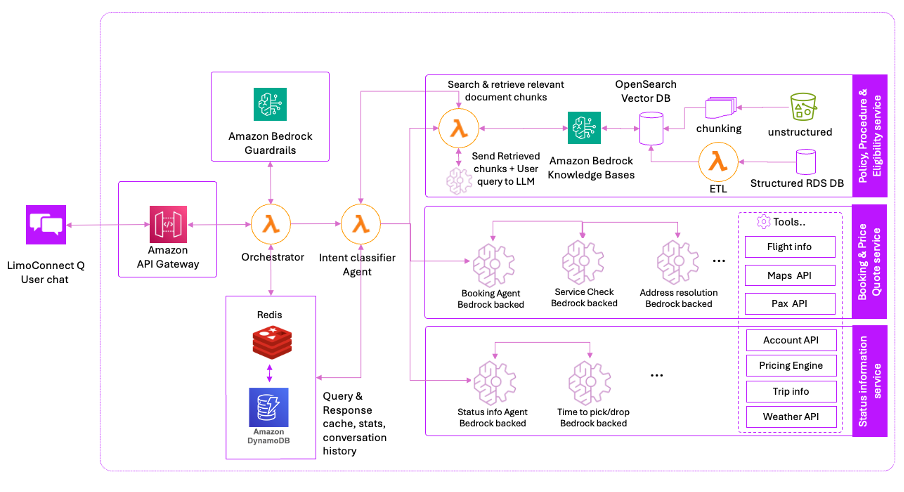

AWS는 Vxceed와 협력하여 LimoConnect Q를 개발했는데, 이는 차별화된 지상 교통 관리 솔루션이다. Amazon Bedrock 및 Lambda를 활용해 안전한 AI 솔루션을 구축하여 여행 예약 및 문서 처리를 간소화했다.

본문은 Trainium과 Inferentia로 여러 확산 트랜스포머를 실행하는 시리즈 중 첫 번째 게시물이다. 이 게시물에서는 PixArt-Sigma를 Trainium과 Inferentia 기반 인스턴스에 배포하는 방법을 소개한다.

본 포스트는 Trainium 및 Inferentia 기반 인스턴스에서 여러 확산 트랜스포머를 실행하는 시리즈 중 첫 번째로, PixArt-Sigma를 Trainium 및 Inferentia 기반 인스턴스에 배포하는 방법을 소개합니다.

DeepSeek-R1 671b 모델을 세밀하게 조정하기 위해 Amazon SageMaker HyperPod 레시피를 사용하는 방법을 소개합니다. SageMaker 훈련 작업과 SageMaker HyperPod를 사용하여 이러한 레시피를 단계별로 구현하는 방법을 보여줍니다.

Amazon Q Business를 사용하여 질문에 답변하고 요약을 제공하며 콘텐츠를 생성하는 등 다양한 AI 기능을 활용하여 금융 연구를 지원하는 방법을 안내합니다.

Amazon Bedrock 에이전트는 간접 프롬프트 삽입에 대비하여 AI 상호작용을 안전하게 보호하는 보안 조치와 전략을 제공합니다.

본 포스트에서는 Amazon Elastic Kubernetes Service (EKS)와 Amazon Bedrock을 사용하여 AWS에서 생성형 AI 애플리케이션을 위한 확장 가능하고 컨테이너화된 RAG 솔루션을 구축하는 방법을 소개하며, 비정형 사용자 파일 데이터를 Amazon Bedrock으로 안전하고 신속하게 가져오는 방법을 제시합니다.

Hexagon은 AWS와 협력하여 HxGN Alix라는 AI 기반 디지털 워커를 개발했는데, 기업을 위한 생성 AI의 혁신적인 혜택을 인식하고 사용자가 기업 자산 관리 제품과 상호 작용하는 방식을 개선하고자 했다. 특화된 AI 솔루션이 효율성을 증대시키고 사용자 만족도를 향상시키는 방법을 보여준다.

IT 지원팀이 겪는 문제를 해결하는 데 도움을 주는 지능형 커뮤니티 에이전트를 구축하는 방법을 소개합니다. 이를 통해 오류 이해, 진단 검토, 조치 및 관련 문서 검토, Jira와 같은 외부 지원 티켓 개설까지의 엔드 투 엔드 부담을 줄일 수 있습니다.

미디어 및 엔터테인먼트 산업에서 마케팅 캠페인의 효과를 이해하고 예측하는 것은 성공에 중요하다. 마케팅 캠페인은 성공적인 비즈니스의 주요 동력으로 작용하며, 새로운 고객을 유치하고 기존 고객을 유지하며 수익을 증대하는 데 중요한 역할을 한다. 그러나 캠페인을 시작하는 것만으로는 충분하지 않다. 이들의 영향력을 극대화하고 성공을 도와주기 위해…

Chronos는 시계열 데이터를 모델링할 언어로 취급하고 사전 훈련된 FM을 사용하여 예측을 생성함. Deutsche Bahn은 Chronos 모델을 활용하여 예측을 재정의하고, 사용 사례를 제공함.

Amazon Bedrock을 통해 모델 및 RAG 평가를 위한 사용자 정의 평가 지표를 개발할 수 있게 되었다. 특정 비즈니스 요구 사항과 평가 기준에 따라 생성형 AI 애플리케이션의 성능을 측정하고 향상시키는 방법을 소개하고 있다.

이 글은 포트폴리오 작성, 기업 연구, 커뮤니케이션을 전문으로 하는 금융 어시스턴트 시스템에 대해 탐구합니다. 아마존 베드락 다중 에이전트 협업 능력 내에서 여러 전문화된 에이전트의 활용을 설명하며, 특히 금융 분석에 적용된 사례를 강조합니다.

WordFinder는 AWS의 생성 적 AI 기술을 활용하여 실어증을 가진 개인들이 독립성을 증가시키는 데 도움을 주는 모바일 클라우드 솔루션입니다. QARC의 Kori Ramajoo 박사, Sonia Brownsett 박사, David Copland 교수, 그리고 실어증을 가진 Scott Harding이 AWS 서비스를 사용하여 이 앱을 개발했습니다.

이 포스트에서는 Jira 통합을 사용한 Amazon Q Business 애플리케이션을 생성하는 방법과 Trusted Advisor 상세 보고서를 포함한 데이터셋을 활용하는 방법을 소개합니다. 이 솔루션은 Amazon Q Business와 같은 새로운 생성적 AI 서비스를 활용하여 데이터 인사이트를 신속하게 얻고 실질적으로 활용하는 방법을 보여줍니다.

Amazon Bedrock에서 Meta Llama 3.2 다중 모달 모델을 파인튜닝하는 포괄적인 최상의 방법과 과학적 통찰을 공유합니다. 이 가이드라인을 따르면 작고 비용 효율적인 모델을 파인튜닝하여 더 큰 모델과 어느 정도 견줄 만한 성능을 달성할 수 있으며, 추론 비용과 지연 시간을 줄이면서도 특정 사용 사례에 대한 높은 정확도를 유지할 수 있습니다.

Anthropic의 MCP는 데이터 소스에 FMs를 연결하는 표준화된 방법을 제공하며, SageMaker AI와 함께 이 기능을 사용할 수 있게 되었다. 글에서는 SageMaker AI와 MCP의 힘을 결합하여 특화된 역할과 자동화된 워크플로를 통해 대출 심사에 새로운 시각을 제공하는 응용 프로그램을 구축하는 예시를 소개했다.

Amazon Web Services(AWS)를 사용하여 문서 번역을 자동화하는 방법을 소개합니다. Amazon Bedrock와 AWS 서버리스 기술을 활용하여 코드 실행, 데이터 관리, 애플리케이션 통합을 서버 관리 없이 수행할 수 있습니다.

이 글에서는 Amazon Bedrock 에이전트와 Amazon Bedrock Data Automation으로 구동되는 자율 AI 에이전트를 활용한 차세대 샘플 솔루션인 에이전트 중심의 자동 주택담보대출 승인을 소개합니다. 이러한 에이전트는 문서를 지능적으로 검증하고 위험을 평가하며 최소한의 인간 개입으로 데이터 주도적인 결정을 내립니다.

Amazon Bedrock Model Distillation은 Meta의 Llama 모델 패밀리와 고급 데이터 증강 기술 및 성능 향상을 강조합니다. 이 기술은 더 크고 능력 있는 Foundation 모델(FM)에서 더 작고 효율적인 모델(student)로 지식을 전이시켜 특정 작업에 뛰어난 특화 모델을 만듭니다.

Amazon Q Business가 익명 사용자 액세스를 지원하기 시작했다. 이 기능을 통해 사용자 인증이 필요하지 않고 콘텐츠가 공개적으로 접근 가능한 Amazon Q Business 애플리케이션을 만들 수 있다. 본문에서는 Amazon Q Business를 사용하여 익명 사용자를 위한 공개적인 생성 AI 애플리케이션을 구축하는 방법을 소개한다.

FloQast가 Anthropics의 Claude 3를 아마존 베드락에서 활용해 AI 기반 회계 변환 솔루션을 구축하는 방법을 소개합니다.

제너레이티브 AI가 산업을 혁신함에 따라 기관들은 그 잠재력을 활용하고자 합니다. 그러나 생산 준비 솔루션에서 완전한 규모의 구현으로 이어지는 여정은 독특한 운영 및 기술적 고려 사항을 제시할 수 있습니다. 본문은 유럽, 중동, 아프리카 (EMEA) 지역의 AWS 고객들이 이 전환을 성공적으로 해내며 얻은 주요 통찰과 교훈을 탐구하며, 이에 따라 따르려는 다른 이들을 위한 로드맵을 제시합니다.

AWS 서비스와 오픈 소스 도구를 통합하여 조직 내 강력한 레드 팀 매커니즘을 구축하는 방법에 대해 탐구합니다. 구체적으로 Data Reply의 레드 팀 솔루션을 소개하며 AI 안전 및 책임 있는 AI 실천을 강화하는 포괄적인 청사진을 논의합니다.

AWS LLM League의 게임화된 지원이 파트너들의 AI 개발 역량을 향상시키는 방법을 소개하며, 작은 언어 모델의 세밀한 조정이 특정 산업의 필요에 맞는 비용 효율적인 전문 솔루션을 제공하는 방법을 보여줍니다.

이 게시물에서는 LLM 마이그레이션 패러다임과 아키텍처를 소개하며, Amazon Bedrock를 사용하여 모델 평가, 프롬프트 생성 및 데이터 인식 최적화를 거친 지속적인 프로세스를 제시합니다.

이 포스트에서는 Amazon Nova를 사용하여 도구 사용을 위한 모델 맞춤화(미세 조정)를 보여줍니다. 도구 사용 사례를 소개하고 데이터셋에 대한 세부 정보를 제공한 후, Amazon Nova 특정 데이터 형식 지정에 대해 안내하고 Amazon Bedrock의 Converse 및 Invoke API를 통해 도구 호출하는 방법을 보여줍니다. Amazon Nova 모델에서 기준선 결과를 얻은 후, 미세 조정 프로세스, 예비 처리량으로 호스팅된 미세 조정된 모델, 그리고 추론에 사용되는 미세 조정된 Amazon Nova 모델을 자세히 설명합니다.

이 게시물에서는 에이전트 개발 프로세스를 간소화하는 Langfuse 통합 솔루션인 오픈 소스 베드락 에이전트 평가 프레임워크를 소개했습니다. 이 평가 프레임워크가 어떻게 약학 연구 에이전트와 통합될 수 있는지를 보여주었습니다. 생물 표지자 질문에 대한 에이전트 성능을 평가하고 이를 Langfuse로 전송하여 질문 유형별 평가 지표를 볼 수 있었습니다.

AWS와 Cisco 팀이 기업급 SQL 생성의 과제를 해결하기 위한 새로운 방법론을 소개했다. NL2SQL 프로세스의 복잡성을 줄이면서 더 높은 정확성과 성능을 제공했다.

AFX 팀은 Nova Lite 모델로 제품 이전하여 매출 업무 프로세스를 향상시켰습니다. 이전으로 비용 절감과 저지연을 달성하며 판매자에게 지능적이고 신뢰할 수 있는 솔루션을 제공했습니다.

이 글에서는 Amazon Bedrock를 통해 Amazon Titan Multimodal Embeddings G1 모델의 멀티모달 임베딩을 이용한 OpenSearch Service를 구축하는 방법을 안내합니다. 이 솔루션은 사용자가 텍스트와 이미지를 모두 쿼리로 제출하여 샘플 소매 이미지 데이터셋에서 관련 결과를 검색할 수 있는 방법을 보여줍니다.

이 글에서는 Amazon SageMaker에서 오픈 소스 NER 및 LLM을 활용하여 AI 기반 문서 처리 플랫폼을 구축하는 방법에 대해 소개합니다.

이 게시물에서는 Amazon Bedrock를 사용하여 RAG 애플리케이션에서 민감한 데이터를 보호하기 위한 두 가지 접근 방식을 탐구합니다. 첫 번째 접근 방식은 Amazon Bedrock 지식 베이스로의 데이터 삽입 전 민감한 데이터를 식별하고 마스킹하는 데 초점을 맞추었으며, 두 번째는 민감한 정보에 대한 접근을 관리하기 위한 세밀한 RBAC 패턴을 시연했습니다. 이러한 솔루션은 생성 모델 AI 애플리케이션에서 민감한 데이터를 보호하기 위한 다양한 접근 방식 중 두 가지에 불과합니다.

Amazon SageMaker Large Model Inference (LMI) 컨테이너 v15가 출시되었습니다. vLLM 0.8.4를 기반으로 한 vLLM V1 엔진을 지원하여 성능 향상과 다중 모달리티 모델 호환성을 제공합니다. 이를 통해 대용량 언어 모델을 최고의 성능으로 확장 가능하게 배포하고 제공할 수 있습니다.